4月19日,Facebook母公司Meta重磅推出了Llama3。

即便大家现在对于大厂和巨头频繁迭代AI模型的行为已经见怪不怪,Meta的Llama3仍旧显得与众不同,因为这是迄今最强大的开源AI模型。

Meta推出了重磅级产品Llama,显然是剑有所指的,其中的寓意也很明显,即是要在激烈的行业竞争中追赶领先者OpenAI。由此,我们也能看出Mata在AI领域的雄心壮志。

成为最强开源模型,Llama3究竟是怎样炼成的?

之所以说Llama3是“最强开源”,是因为它在模型架构,预训练数据,扩大预训练规模以及指令微调方面都做出了重要的调教。

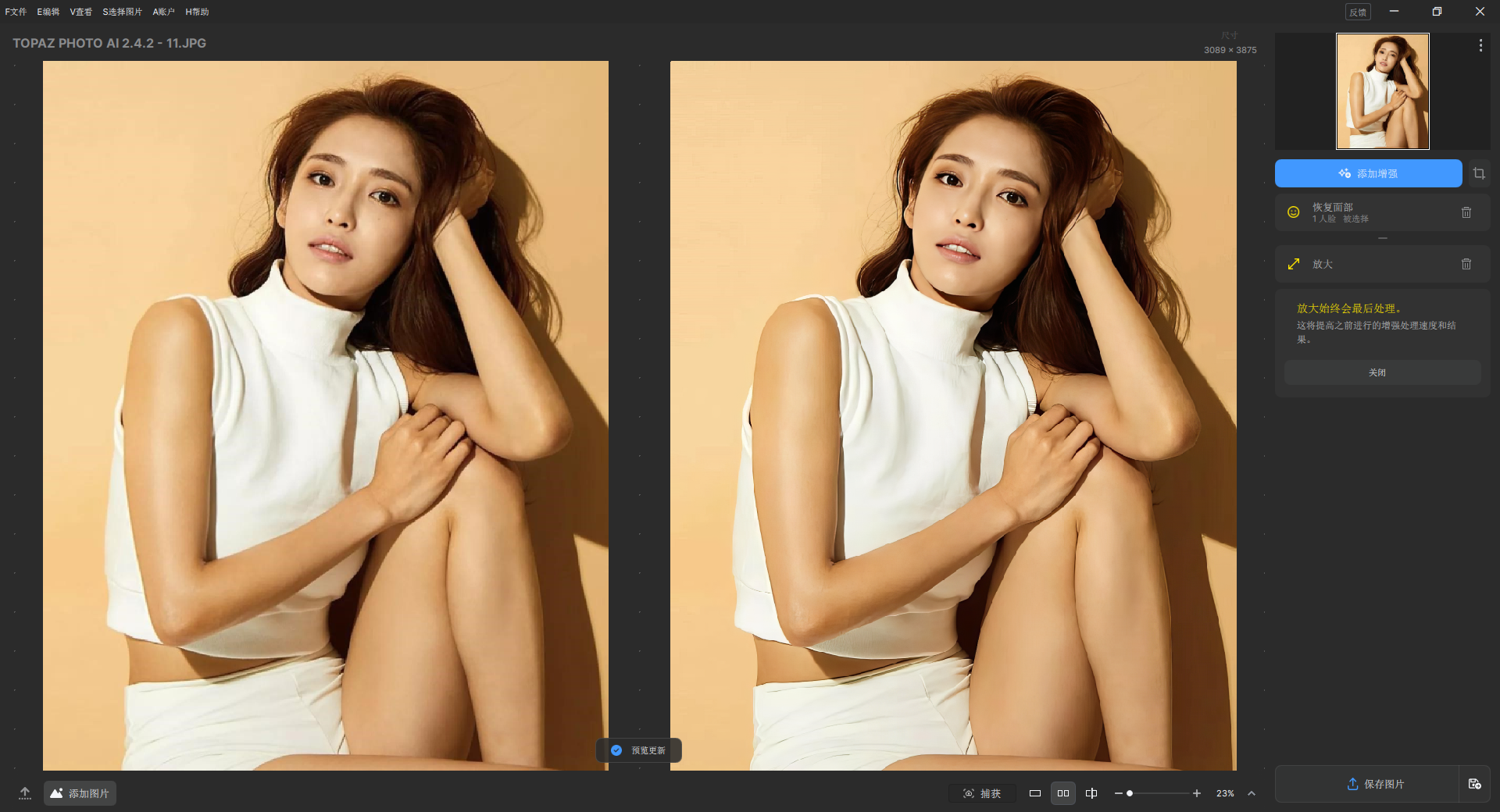

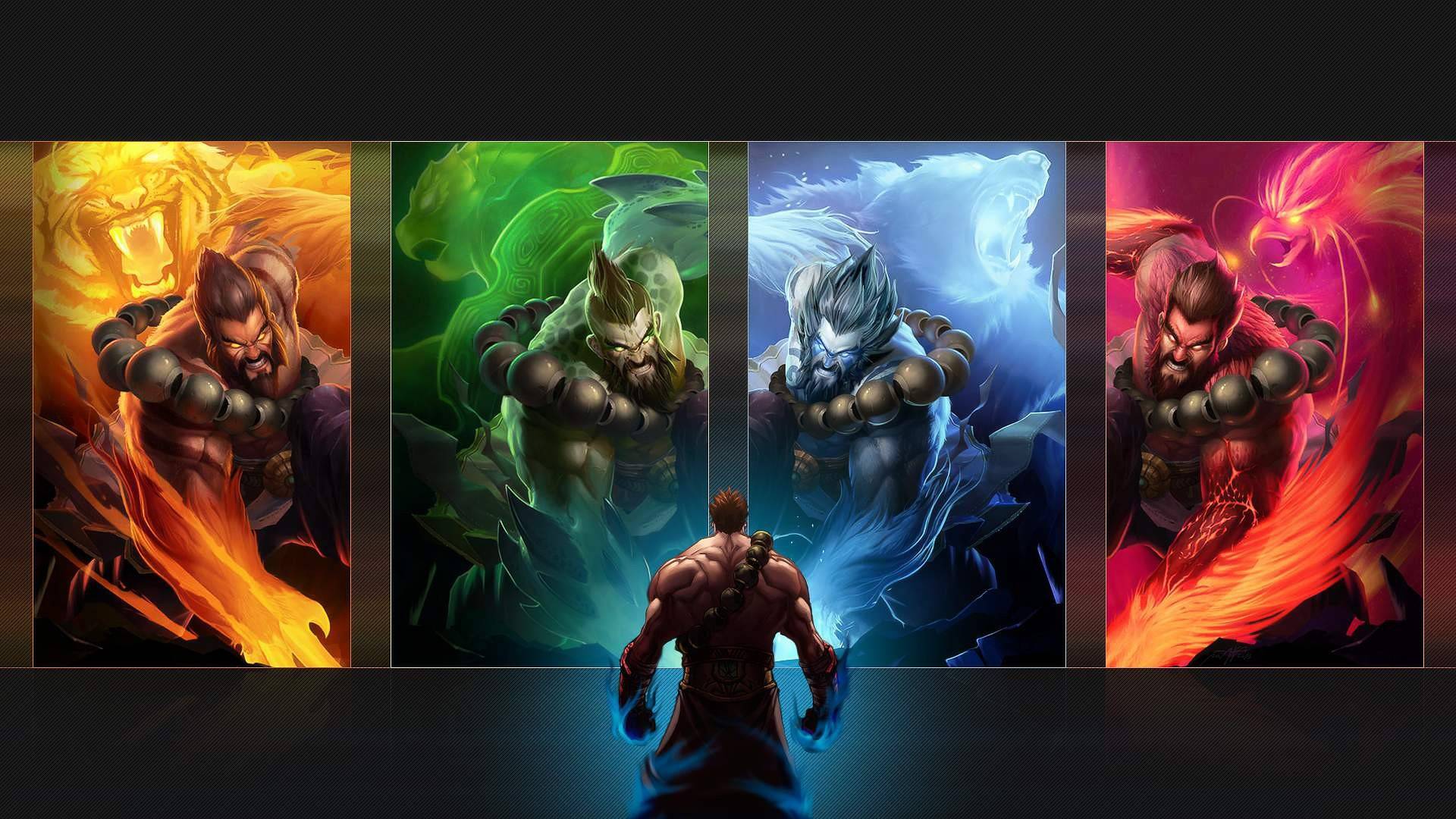

![图片[1]-史上最强大开源模型”的Llama3-本地完整视频部署教程-逃课猫Deepfacelab|AI智能研究站](https://img10.360buyimg.com/ddimg/jfs/t1/166229/27/45375/24138/662ba417F8d757eb8/5d0aa37dbf0368ec.jpg)

在模型架构方面,Llama 3 采用了相对标准的纯解码器 transformer 架构。与 Llama 2 相比,Llama 3更进行了几项关键改进。Llama 3 使用了一个 128K token 的 tokenizer,它能更有效地编码语言,从而大幅提高模型性能;Meta还在 8B 和 70B 大小的模型中都采用了分组查询关注,以便提高Llama3的运行效率;此外,Meta还在8192 个 token 的序列上对模型进行了训练,并使用掩码来确保自注意力不会跨越文档边界。

我们看下演示视频:

webui界面演示:

完整的部署视频:

资料下载:

1、该资源仅供学习和研究传播,大家请在下载后24小时内删除,一切关于该资源商业行为与逃课猫智能研究站(taokemao.cn)无关。

2、请勿将该软件程序进行商业交易、转载、违法运营等行为,该软件只为研究、学习所提供,该软件程序使用后发生的一切问题与本站无关。

3、若本程序源/码侵犯了您的权益,请及时联系我们予以删除!

4、本程序仅供研究学习使用,切勿商用以及违法使用!

5、本站收费内容,只用于维持域名注册、网页空间租用等费用日常开销。

6、本站免费、含会员内容的软件工具,皆不包含人工技术服务教程等服务,大部份已提供视频教程,请自行网上搜索。